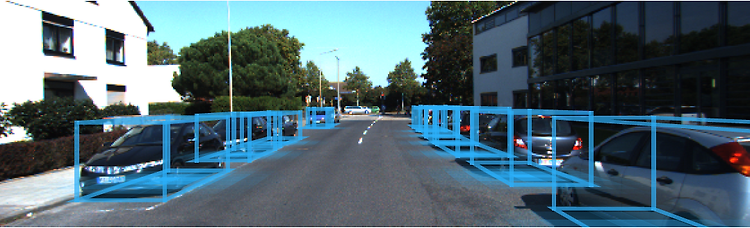

Dataset (KITTA)

The KITTI Vision Benchmark Suite

The KITTI Vision Benchmark Suite

When using this dataset in your research, we will be happy if you cite us: @INPROCEEDINGS{Geiger2012CVPR, author = {Andreas Geiger and Philip Lenz and Raquel Urtasun}, title = {Are we ready for Autonomous Driving? The KITTI Vision Benchmark Suite},

www.cvlibs.net

이미지 데이터셋에 대한 각 사진 내 아래 format 데이터 레이블 제공

format :

type, truncated, occluded, alpha, bbox(4), dimensions(3), location(3), ratation_y, scoretype : {'Car', 'Van', 'Truck', 'Pedestrian', 'Person_sitting', 'Cyclist', 'Tram', 'Misc', 'DontCare'}

truncated : [0.0 ~ 1.0] 실수 (이미지의 경계를 벗어난 개체)

occluded : {0, 1, 2, 3} 가려짐 상태 (0 완전히 보여짐, 1 살짝 가려짐, 2 많이 가려짐, 3 알 수 없음)

alpha : [$-\pi$ ~ $\pi$] 실수, 객체의 관측각

bbox(4) : 2D 경계 박스 (left, top, right, bottom 좌표)

dimensions(3) : 3D 객체 차원 (height, width, length) - 미터법

location(3) : 3D 객체 위치 (x, y, z 카메라 좌표) - 미터법

ratation_y : [$-\pi$ ~ $\pi$] 실수, Y축 카메라 좌표에서의 각도

score : 검출 신뢰도 (점수) - 테스트용

Abstract

단일 이미지에서 3D 객체를 감지하는 것은 매우 어려운 작업이다.

단일 이미지를 통한 3D Object Detection은 LiDAR 시스템의 10% 수준에도 미치지 못하고 있다.

→ 원근 이미지 표현(2차원 표현)

→ 물체의 외관과 규모는 깊이에 따라 크게 달라지며 의미 있는 거리는 추론하기 어렵다.

→ 3D로 세계를 추론하는 능력이 선행되어야 한다.

이미지 기반 feature를 3D orthographic space에 mapping하여 2차원 한계를 벗어날 수 있는 orthographic feature transform

→ 일관된 스케일, 객체 간 거리 존재하는 도메인(3D Space)에서 장면의 공간 구성에 대해 추론 가능

→ KITTI Dataset 사용, 딥러닝 적용

Introduction

현재까지 3D 객체 감지 → LiDAR Point Clouds 기반 (Absolute Depth Information)

arxiv.org/pdf/1903.09847v4.pdf

→ LiDAR 절대 깊이 정보가 없는 이미지 방법의 성능은 상당히 뒤쳐져있음.

LiDAR 고비용 문제, 장거리 LiDAR Point Clouds 희소성, 중복 센서 사용 등의 문제로 인해 단일 이미지를 통한 3D Object Detection은 중요한 도전 과제.

- Perspective Projection (원근 투영) : 단일 물체의 배율이 카메라부터에 거리에 따라 달라짐

- → 직교 조감도 (LiDAR-based)의 경우 규모는 동질적

OFT (Orthographic Feature Transform)

원근 RGB 이미지에서 추출된 특징 집합(a set of feature)를 직교 조감도 feature map에 mapping

→ 깊이에 대한 명시적인 개념의 의존하지 않음

→ 조감도(birds-eye-view)의 각 위치와 관련된 이미지 특징을 결정할 수 있는 내부 표현 구축 (builds up internal representation)

→ 심층 합성곱 신경망 (DCNN) (topdown 방식)

- We introduce the orthographic feature transform (OFT) which maps perspective image-based features into an orthographic birds-eye-view, implemented efficiently using integral images for fast average pooling.

- We describe a deep learning architecture for predicting 3D bounding boxes from monocular RGB images.

- We highlight the importance of reasoning in 3D for the object detection task.

Related Work

2D 객체 감지

- single stage detectors : YOLO, RetinaNet

- two stage detectors : fast R-CNN, FPN

LiDAR를 이용한 3D 객체 감지

- LiDAR Point Clouds

- Points Sets 이미지 평면에 투영 → Fast R-CNN 적용

- 조감도 표현으로 변환 → Points 별 높이 인코딩

- 센서 융합 방식

이미지에서 3D 객체 감지 (기존)

- 이미지에서 2D bound box 검출 → 3D parameter regression / 3D 템플릿 적용

- 각 3D 템플릿 박스에 대해 점수 매기고, 적절한 박스 검색

- Stereo Geometry (깊이 명시적 추정)

→ 각 객체에 대해서 독립적으로 처리 / 장면에 대한 공동 추론 배제

3D Object Detection Architecture

- 프론트엔드 ResNet 특징 추출기 (feature extractor) → 다단계의 특징맵 (multi-scale feature map) 추출

- 이미지 기반 특징맵 → 직교 조감도 표현으로 변환

- Voxel-based features $g(x, y, z)$는 Image-based features $f(u, v)$를 투영 복셀 영역(projected voxel area)에 누적(accumulating)하여 생성한다.

- Voxel-based Features $g(x, y, z)$는 수직 차원을 따라 축소되어 직교 바닥 평면 (orthographic ground plane) features $h(x, z)$를 생성한다.

- 즉, $f(u, v)$ → (투영 영역에 누적) → $g(x, y, z)$ → 수칙 차원 축소 → $h(x, z)$

- topdown 네트워크 (ResNet residual units) → 이미지에서 관찰된 features를 조감도로 처리

- 생성한 Output Heads 집합 (객체 클래스 / 바닥 평면에서의 위치 h(x, z) / 신뢰도 점수 (confidence score) / 위치 오프셋 (position offset) / 차원 오프셋 (dimension offset) / 방향 벡터 포함)

- non-maximum suppression, decoding (클래스별 신뢰도 점수 맵에서 최고점 식별, 경계 상자 생성)

Orthographic Feature Transform

$G$ : 3차원 치수가 각각 $W$, $H$, $D$, Voxel Size가 $r$인 균일한 간격의 3D 격자

각 Voxel은 6면체 (Cube)

3D Voxel Map $g(x, y, z)∈\R^n$ ($n$-차원)

Image-based Feature Map $f(u, v)∈\R^n$

Voxel 맵은 카메라로부터 거리가 $y_0$인 바닥 평면에 고정된 $G$

Voxel의 2차원 정사영(투영) Image Feature Map f의 영역에 걸친 형상을 누적 (accumulate)하여 Voxel Feature g(x, y, z)를 얻는다. upper-left $(u_1, v_1)$, bottom-right $(u_2, v_2)$에 의해 근사화한다.

$f$는 카메라 초점 길이 (focal length), $(c_u, c_v)$는 원점 (principle point)

Image Feature Map에서 Projection 된 Voxel의 Bound Box에 대한 평균 풀링을 통해 Voxel Feature Map의 적절한 위치에 해당 객체 Feature를 할당한다.

조감도 수직 평면 (Orthographic Feature Map)은 학습된 가중치 행렬 $W(y)∈\R^{n\times n}$을 이용해 수직 축을 따라 Voxel Feature를 합쳐서 구한다.

Experiments

Architecture Front-end feature extractor : ResNet-18 Network (병목 현상이 없는 16계층)

80m x 4m x 80m의 Voxel Grid 사용, Grid 해상도 0.5m

KITTI 3D Object Detection Benchmark Dataset 사용하여 Train (3712개) 및 Evaluate(3769개)

데이터 확대를 위해 1) Random Cropping 2) Scaling and Horizontal Flipping 3) Adjusting the Camera Calibration parameter 등을 통해 데이터 확대

SGD (확률적 경사 하강법, Stochastic Gradient Descent) 사용

epoch : 600, batch size : 8, momentum : 0.9, Leaning Rate : 10^-7

Loss Function : 평균

결과 :

→ 좌측(연구), 우측(Mono3D) 비교 : Mono3D 범위를 훨씬 벗어난 먼 물체도 감지 및 적용

→ 좌측(이미지), 우측(조감도 형식의 신뢰도 점수 Heat Map)

→ 훈련 횟수 (epoch)에 따른 신뢰도 점수 Heat Map 프로세싱 과정 (불확실성 해결됨)

References

- Beltran, C. Guindel, F. M. Moreno, D. Cruzado, F. Garcia, and A. de la Escalera. BirdNet: a 3D object detection framework from LiDAR information. arXiv preprint arXiv:1805.01195, 2018. 1, 2

- Chabot, M. Chaouch, J. Rabarisoa, C. Teuliere, and` T. Chateau. Deep MANTA: A coarse-to-fine manytask network for joint 2D and 3D vehicle analysis from monocular image. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 2040–2049, 2017. 2

- Chen, K. Kundu, Z. Zhang, H. Ma, S. Fidler, and R. Urtasun. Monocular 3D object detection for autonomous driving. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 2147–2156, 2016. 2, 5, 6, 7, 8

- Chen, K. Kundu, Y. Zhu, A. G. Berneshawi, H. Ma, S. Fidler, and R. Urtasun. 3D object proposals for accurate object class detection. In Advances in Neural Information Processing Systems, pages 424–432, 2015. 2, 6, 7

- Chen, H. Ma, J. Wan, B. Li, and T. Xia. Multi-view 3D object detection network for autonomous driving. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, volume 1, page 3, 2017. 1, 2

- Du, M. H. Ang Jr, S. Karaman, and D. Rus. A general pipeline for 3D detection of vehicles. arXiv preprint arXiv:1803.00387, 2018. 1, 2

- Everingham, L. Van Gool, C. K. Williams, J. Winn, and A. Zisserman. The Pascal Visual Object Classes (VOC) challenge. International Journal of Computer Vision, 88(2):303–338, 2010. 2

- Geiger, P. Lenz, and R. Urtasun. Are we ready for autonomous driving? The KITTI vision benchmark suite. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2012. 1, 5

- Girshick. Fast R-CNN. In Proceedings of the IEEE International Conference on Computer Vision, pages 1440–1448, 2015. 6

- He, X. Zhang, S. Ren, and J. Sun. Deep residual learning for image recognition. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 770–778, 2016. 2

- Huang, Y. Yang, Y. Deng, and Y. Yu. Densebox: Unifying landmark localization with end to end object detection. arXiv preprint arXiv:1509.04874, 2015. 4

- Ioffe and C. Szegedy. Batch normalization: Accelerating deep network training by reducing internal covariate shift. In Proceedings of The 32nd International Conference on Machine Learning, pages 448– 456, 2015. 5

- Kasagi, T. Tabaru, and H. Tamura. Fast algorithm using summed area tables with unified layer performing convolution and average pooling. In Machine Learning for Signal Processing (MLSP), IEEE 27th International Workshop on, pages 1–6, 2017. 2

- Kehl, F. Manhardt, F. Tombari, S. Ilic, and N. Navab. SSD-6D: Making rgb-based 3d detection and 6d pose estimation great again. In Proceedings of the International Conference on Computer Vision, pages 22–29, 2017. 2

- Ku, M. Mozifian, J. Lee, A. Harakeh, and S. Waslander. Joint 3D proposal generation and object detection from view aggregation. arXiv preprint arXiv:1712.02294, 2017. 1, 2

- Li, T. Zhang, and T. Xia. Vehicle detection from 3D lidar using fully convolutional network. arXiv preprint arXiv:1608.07916, 2016. 2

- -Y. Lin, P. Dollar, R. B. Girshick, K. He, B. Hari-´ haran, and S. J. Belongie. Feature pyramid networks for object detection. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, volume 1, page 3, 2017. 2

- -Y. Lin, P. Goyal, R. Girshick, K. He, and P. Dollar.´ Focal loss for dense object detection. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2018. 2, 4

- -Y. Lin, M. Maire, S. Belongie, J. Hays, P. Perona, D. Ramanan, P. Dollar, and C. L. Zitnick. Mi-´ crosoft COCO: Common objects in context. In European Conference on Computer Vision, pages 740–755. Springer, 2014. 2

- Liu, D. Anguelov, D. Erhan, C. Szegedy, S. Reed, C.-Y. Fu, and A. C. Berg. SSD: Single shot multibox detector. In European Conference on Computer Vision, pages 21–37. Springer, 2016. 2

- Masters and C. Luschi. Revisiting small batch training for deep neural networks. arXiv preprint arXiv:1804.07612, 2018. 6

- Minemura, H. Liau, A. Monrroy, and S. Kato. Lmnet: Real-time multiclass object detection on CPU using 3D LiDARs. arXiv preprint arXiv:1805.04902, 2018. 1, 2

- Mousavian, D. Anguelov, J. Flynn, and J. Koseckˇ a.´ 3D bounding box estimation using deep learning and geometry. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 5632–5640. IEEE, 2017. 2, 5

- Novak. Vehicle detection and pose estimation for autonomous driving. PhD thesis, Masters thesis, Czech Technical University in Prague, 2017. Cited on, 2017. 2, 6

- C. Pham and J. W. Jeon. Robust object proposals re-ranking for object detection in autonomous driving using convolutional neural networks. Signal Processing: Image Communication, 53:110–122, 2017. 2

- Poirson, P. Ammirato, C.-Y. Fu, W. Liu, J. Kosecka, and A. C. Berg. Fast single shot detection and pose estimation. In 3D Vision (3DV), 2016 Fourth International Conference on, pages 676–684. IEEE, 2016. 2

- R. Qi, W. Liu, C. Wu, H. Su, and L. J. Guibas. Frustum pointnets for 3D object detection from RGB-D data. arXiv preprint arXiv:1711.08488, 2017. 1, 2

- Redmon and A. Farhadi. Yolov3: An incremental improvement. arXiv preprint arXiv:1804.02767, 2018. 2

- Ren, K. He, R. Girshick, and J. Sun. Faster R-CNN: Towards real-time object detection with region proposal networks. In Advances in Neural Information Processing Systems, pages 91–99, 2015. 2, 4

- Russakovsky, J. Deng, H. Su, J. Krause, Satheesh, S. Ma, Z. Huang, A. Karpathy, A. Khosla, M. Bernstein, et al. Imagenet large scale visual recognition challenge. International Journal of Computer Vision, 115(3):211–252, 2015. 2

- Shrivastava, A. Gupta, and R. Girshick. Training region-based object detectors with online hard example mining. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 761–769, 2016. 4

- Viola and M. Jones. Rapid object detection using a boosted cascade of simple features. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, volume 1, pages I–I. IEEE, 2001. 2, 4

- Wirges, T. Fischer, J. B. Frias, and C. Stiller. Object detection and classification in occupancy grid maps using deep convolutional networks. arXiv preprint arXiv:1805.08689, 2018. 1, 2

- Wu and K. He. Group normalization. European Conference on Computer Vision, 2018. 5

- Xiang, W. Choi, Y. Lin, and S. Savarese. Datadriven 3D voxel patterns for object category recognition. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 1903– 1911, 2015. 2

- Xiang, W. Choi, Y. Lin, and S. Savarese. Subcategory-aware convolutional neural networks for object proposals and detection. In Applications of Computer Vision (WACV), IEEE Winter Conference on, pages 924–933. IEEE, 2017. 2

- -L. Yu, T. Westfechtel, R. Hamada, K. Ohno, and S. Tadokoro. Vehicle detection and localization on birds eye view elevation images using convolutional neural network. In IEEE International Symposium on Safety, Security and Rescue Robotics (SSRR), volume 5, 2017. 1, 2

- Zeeshan Zia, M. Stark, and K. Schindler. Are cars just 3D boxes? Jointly estimating the 3D shape of multiple objects. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 3678–3685, 2014. 2